基于视觉提示的具身智能空间感知增强方法研究

Research on Spatial Perception Enhancement Method for Embodied Intelligence Based on Visual Prompting

快速导航

1. 数据集说明

主评测数据:paper_release/data/dist_all(160 个样本)。

GraspNet-Desk(0-99)

Real-Desk(100-129)

Sim-Desk(130-159)

GraspNet-Desk(0-99)样例

Real-Desk(100-129)样例

Sim-Desk(130-159)样例

2. 方法内容

论文主方法(SVA + SVP + 闭环执行)—— vlm-spatial-grasp

| 文件 | 功能 |

|---|---|

| vision_agent_v2.py | 结构化视觉锚点(SVA)+ 结构化视觉提示(SVP)主链路 |

| main_vlm.py | 端到端执行入口(支持 VLM_METHOD=svp/qwen) |

| grasp_process.py | 抓取候选生成与筛选 |

| manipulator_grasp/ | MuJoCo 机械臂执行环境 |

论文对比方法(基线) —— paper_release/experiments

ours_svp_batch_inference.py

qwen_batch_inference.py

gpt_batch_inference.py

3. 论文实验映射

| 论文表号 | 含义 | 脚本 | 输出 |

|---|---|---|---|

| 表3-2 | 三域数据规模统计 | 按 dist_all 前缀区间统计 | 数据划分口径 |

| 表3-4 | 三域静态评估(命中率/偏差) | paper_release/experiments/table3_3.py | results/tables/table3_3_ai_results*/summary.csv |

| 表4-1 | Full(Oracle-Action)主对比 | paper_release/experiments/table4_1.py | table4_full.csv / table4_full_recomputed.csv |

| 表4-2 | Strict(Supplementary)一致性评估 | paper_release/experiments/table4_2.py | table4_2_strict.csv / table4_2_strict_recomputed.csv |

注意:table3_3.py 是历史脚本名,用于当前论文表3-4对应评估。

4. 结果图(表3-4对应)

A_hit_g(抓取命中率,越高越好)

A_hit_p(放置命中率,越高越好)

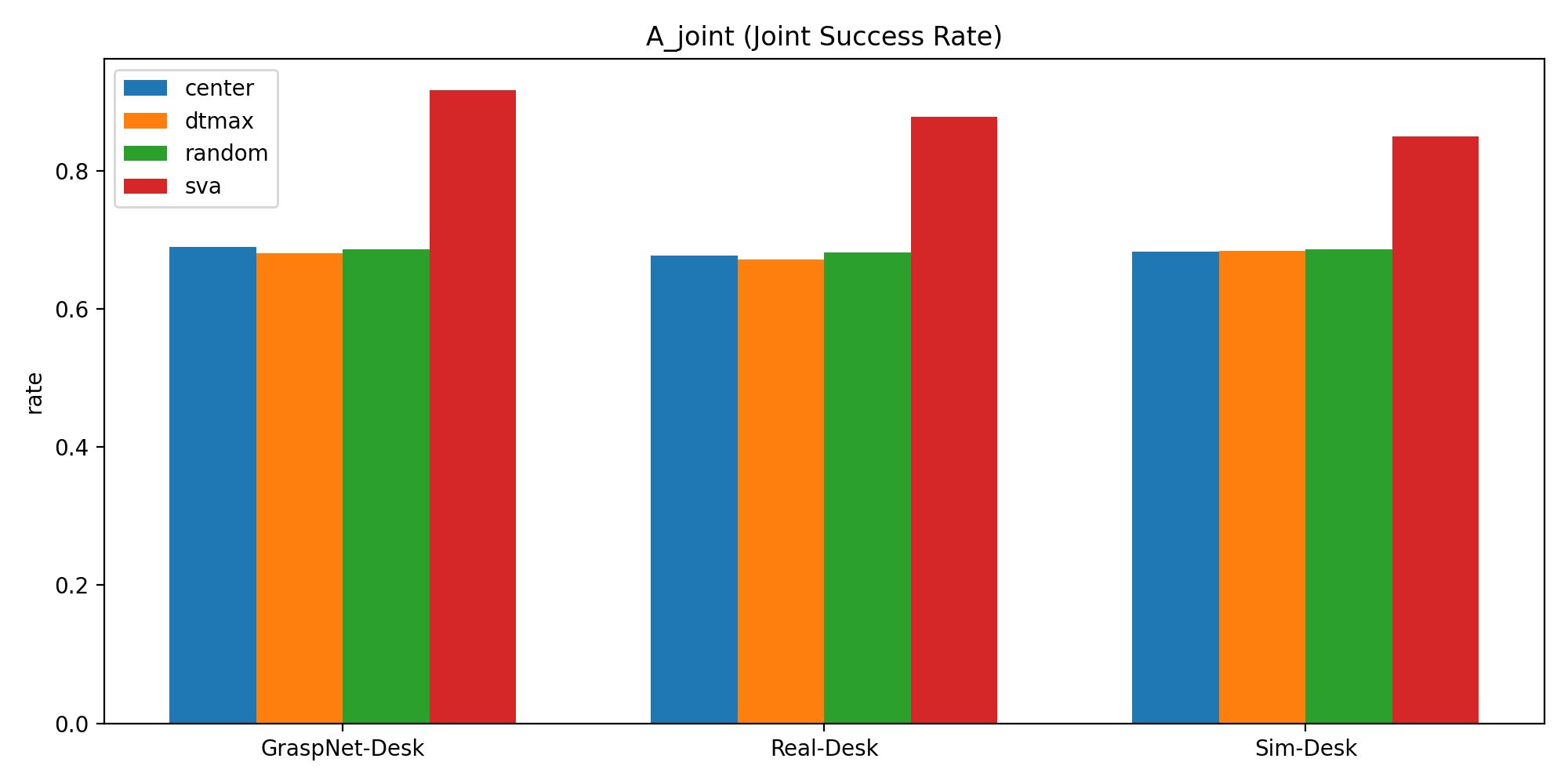

A_joint(联合一致性,越高越好)

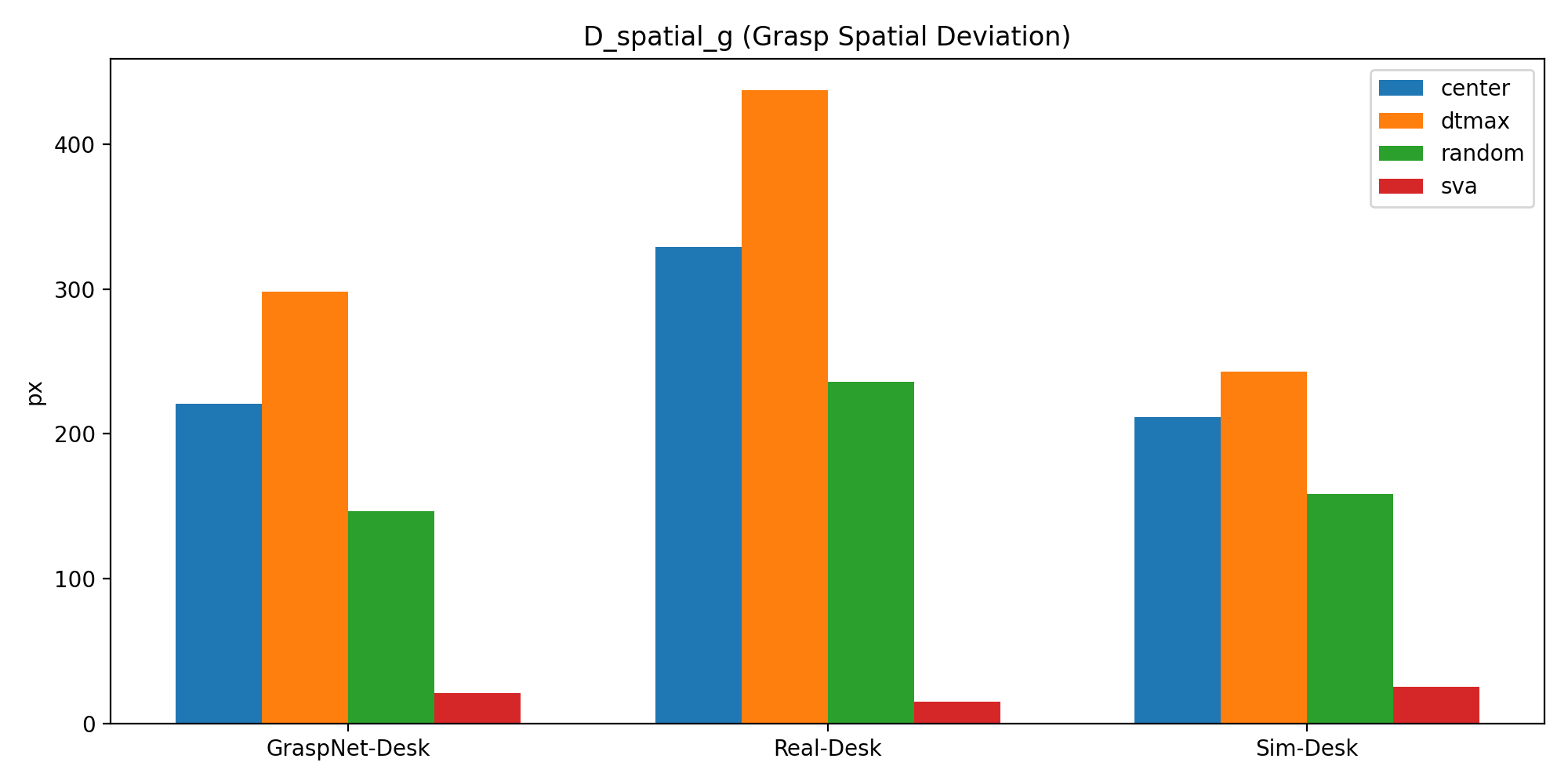

D_spatial_g(抓取偏差 px,越低越好)

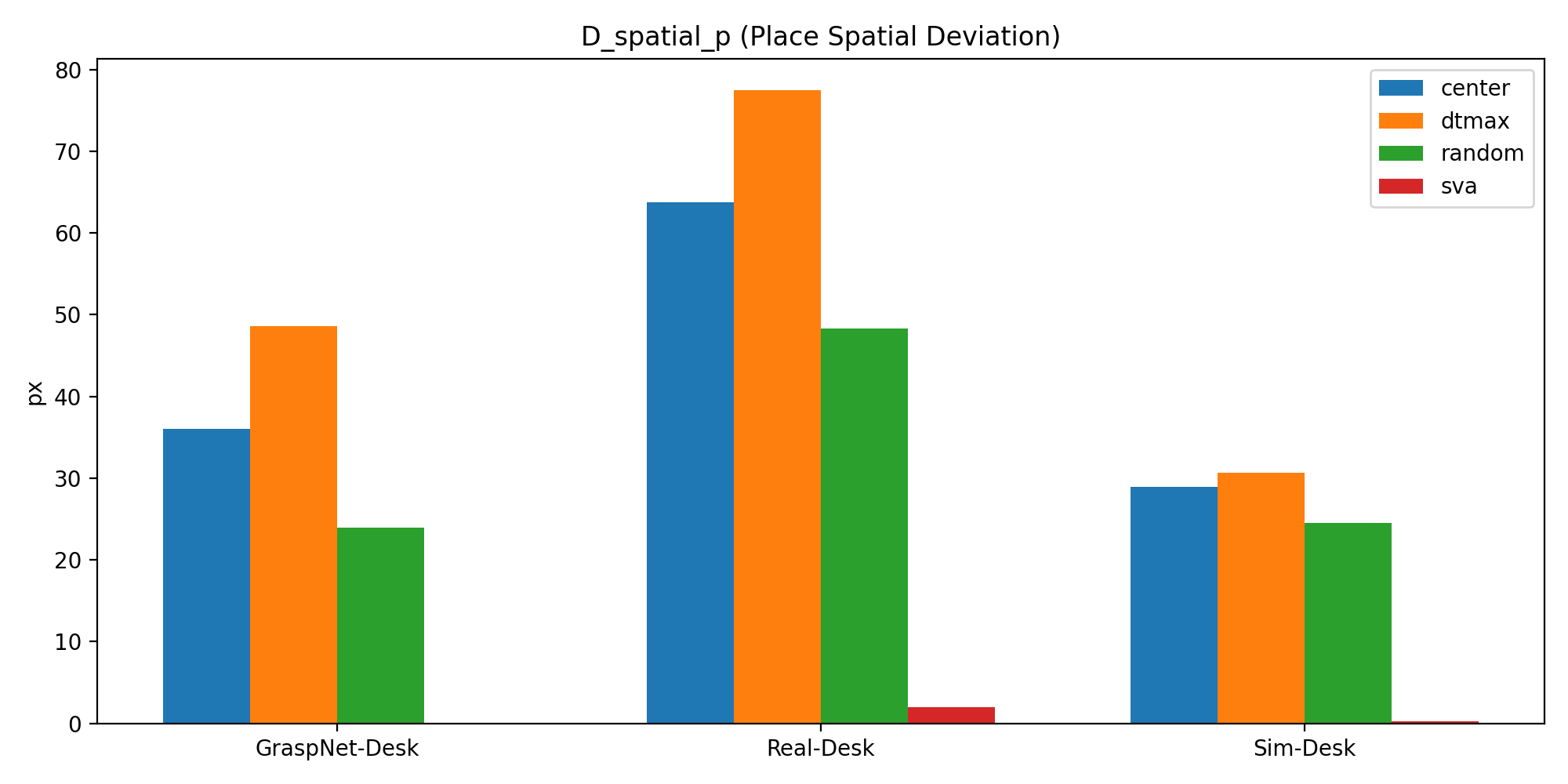

D_spatial_p(放置偏差 px,越低越好)